Probabilmente non puoi distinguere una vera voce umana da un clone di intelligenza artificiale e non sei solo in questa lotta. Ma ecco la parte sorprendente. Il tuo cervello sta già iniziando a capire la differenza.

ricercatori I ricercatori dell’Università di Tianjin e dell’Università cinese di Hong Kong hanno testato la capacità di 30 ascoltatori di rilevare il parlato generato dall’intelligenza artificiale e i risultati sono stati imbarazzanti.

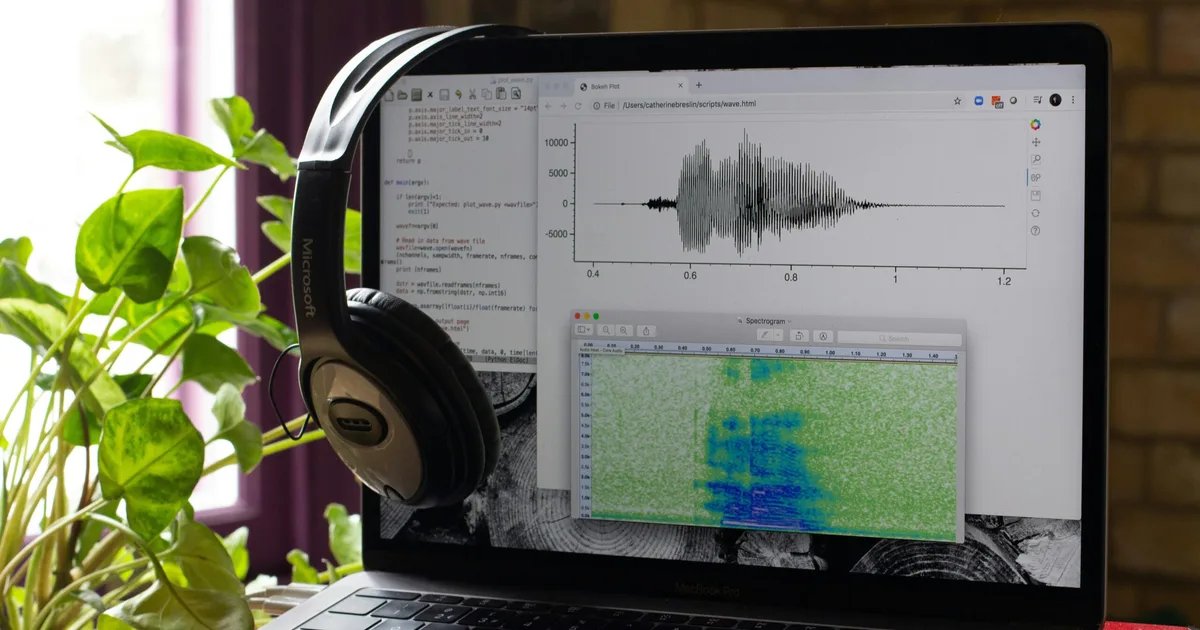

I partecipanti non riuscivano costantemente a distinguere i suoni reali da quelli sintetici, anche dopo una breve sessione di allenamento progettata per aiutarli a migliorare. Ma quando gli scienziati hanno esaminato le registrazioni dei nervi provenienti dalle teste dell’elettroencefalografia (EEG), hanno scoperto che c’era qualcos’altro che stava succedendo sotto la superficie. Il sistema uditivo stava tranquillamente facendo i suoi compiti.

Il cervello sente ciò che gli manca

Lo studio, pubblicato su eNeuro, ha utilizzato due tipi di voci di intelligenza artificiale e frasi pronunciate da persone reali. Un set era un discorso sintetico di base, l’altro è stato ottimizzato per sembrare più umano.

Gli ascoltatori hanno premuto i pulsanti per indovinare se ogni suono era reale o falso e hanno sbagliato. Troppo. Ma i cappucci EEG che tracciano l’attività neurale raccontano una storia più interessante.

Dopo soli 12 minuti di allenamento, queste risposte neurali hanno cominciato a divergere. Il cervello ha iniziato a etichettare il parlato sintetico in modo diverso in tre momenti diversi dopo aver sentito un suono: circa 55 millisecondi, 210 millisecondi e 455 millisecondi. Queste sono le prime fasi di elaborazione, molto prima che il pensiero cosciente entri in gioco.

Perché le tue orecchie sono più avanti del tuo cervello?

Hai a che fare con il divario tra percezione e decisione. Il tuo sistema uditivo registra sottili impronte audio nelle voci dell’intelligenza artificiale, ma non ha ancora collegato quei segnali al pulsante “questo è falso” nella tua mente.

I ricercatori hanno trovato effettive differenze fisiche nei suoni che spiegano questa disconnessione. L’analisi acustica ha mostrato che il parlato reale e quello dell’intelligenza artificiale variavano da una modulazione compresa tra 5,4 e 11,7 Hz, che è collegata al modo in cui il nostro cervello tiene traccia dei dettagli del discorso rapido come i fonemi e l’inizio delle sillabe. Apparentemente le voci dell’intelligenza artificiale non riescono a riprodurre perfettamente queste microvariazioni, anche se suonano incredibilmente naturali. Ancora.

Cosa significa questo per le truffe deepfake?

Questa ricerca porta effettivamente buone notizie. Ciò significa che gli esseri umani non sono indifesi contro le frodi sulla clonazione vocale e che l’hardware biologico funziona perfettamente. Dobbiamo solo imparare ad usarlo.

Gli strumenti futuri potrebbero insegnare alle persone ad ascoltare segnali specifici che il loro cervello ha già rilevato. Invece di consigli generali come “fai attenzione”, possiamo ricevere programmi di formazione mirati che aiutano a collegare la percezione neurale al processo decisionale consapevole. Ci sono dati, ci sono indizi e ora si tratta di collegare i punti.

Per ora, il risultato è stranamente rassicurante. Il tuo cervello sta lavorando più duramente di quanto pensi ed è già in sintonia con le voci dell’intelligenza artificiale, anche se la tua mente cosciente non l’ha ancora completamente raggiunta.

Link alla fonte: www.digitaltrends.com