La reale portata del problema di Grok con i deepfake sta diventando sempre più chiara mentre la piattaforma di social media e la sua startup di intelligenza artificiale xAI affrontano indagini in corso sulle barriere di sicurezza del chatbot.

Secondo rapporto Centro per la lotta all’odio digitale (CCDH) e congiunto indagine Di New York TimesGrok è stato ancora in grado di creare circa 3 milioni di immagini sessualmente esplicite, di cui 23.000 raffiguranti bambini, nei 10 giorni successivi alla presunta repressione di xAI sui deepfake.striscia.CCDH ha testato un campione di risposte utilizzando lo strumento di modifica con un clic di Grok, che è ancora disponibile per gli utenti X, e ha stimato che più della metà delle risposte del chatbot contenevano contenuti sessuali.

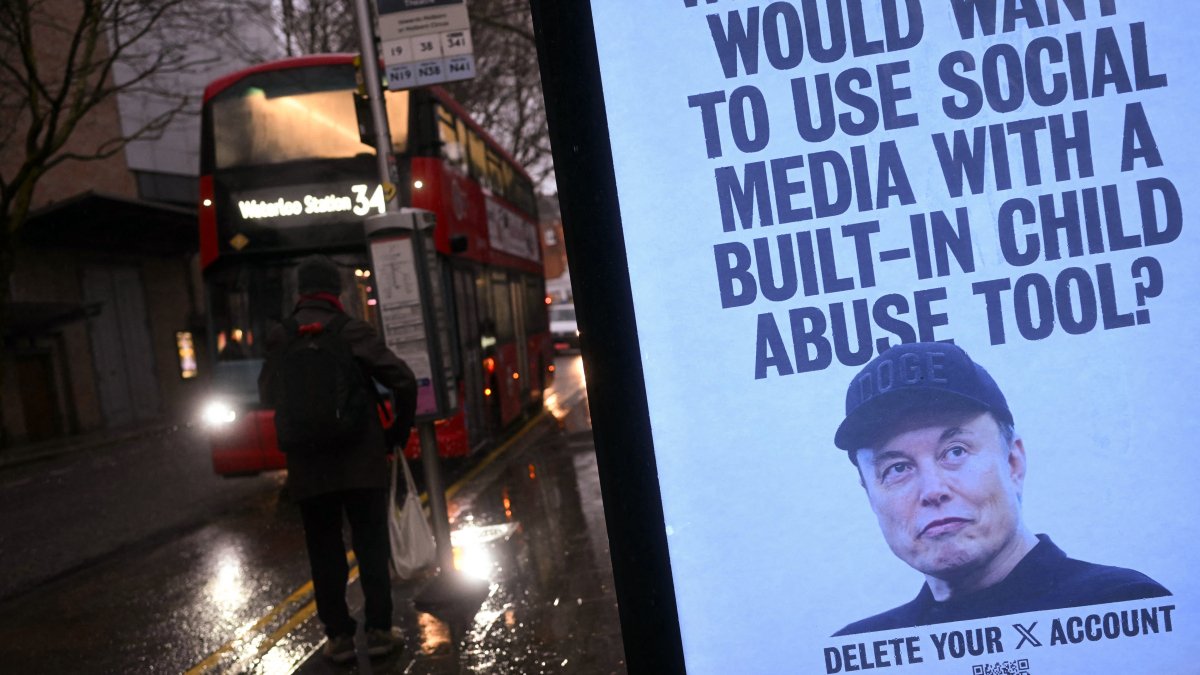

Grok Ban: i paesi valutano la possibilità di bloccare il chatbot AI sui contenuti sessuali non consensuali

New York Times Il rapporto ha rilevato che circa 1,8 milioni dei 4,4 milioni di immagini di Grock erano di natura sessuale, alcune delle quali raffiguravano influencer e celebrità di alto profilo. La pubblicazione attribuisce anche l’aumento dell’utilizzo di Grok ai post pubblici del CEO Elon Musk in cui si ritrae in bikini disegnati da Grok.

“Si tratta di abusi su donne e ragazze su scala industriale”, ha dichiarato alla pubblicazione il direttore esecutivo del CCDH, Imran Ahmed. “Gli strumenti nude esistevano, ma non hanno mai avuto la stessa prevalenza, facilità d’uso o integrazione in una piattaforma più ampia come quella di Elon Musk e Grock.”

Grok è stato criticato per aver creato materiale pedopornografico (CSAM) in seguito alle segnalazioni secondo cui il chatbot X avrebbe creato immagini di minorenni poco vestite. La piattaforma ha riconosciuto il problema e ha affermato che stava affrontando urgentemente le “lacune di sicurezza”.

Mashable Velocità della luce

xAI, la società madre di Grock, è sotto indagine da parte di diversi governi stranieri e dello stato della California per il suo ruolo nella creazione di rapporti sessuali o Deepfake “svestiti”. persone e minori. Diversi paesi hanno addirittura vietato temporaneamente la piattaforma mentre le indagini continuano.

In risposta, xAI ha affermato che proibirà a Grok di modificare le foto di persone reali caricate dagli utenti per mostrare abiti succinti, preoccupazioni iniziali segnalate dagli utenti all’inizio di questo mese. Tuttavia, messaggi recenti da Custode ha scoperto che gli utenti dell’app Grok possono comunque creare immagini modificate dall’intelligenza artificiale di donne reali in bikini e poi caricarle sul sito.

Questo tweet non è al momento disponibile. Potrebbe essere in fase di download o è stato eliminato.

In un rapporto di agosto, l’editore di Mashable Timothy Beck Werth ha notato problemi con le barriere di sicurezza di Grok, incluso il fatto che Grok Imagine ha prontamente creato immagini e video sessualmente espliciti di persone reali. Grok Imagine include impostazioni di moderazione e misure di sicurezza progettate per bloccare determinate richieste e risposte, ma Musk ha anche pubblicizzato Grok come uno dei pochi chatbot popolari a includere un’impostazione “Naughty” per i contenuti sessuali. OpenAI ha anche accennato a un’impostazione NSFW nel mezzo di cause legali secondo cui il suo prodotto ChatGPT non è sicuro per gli utenti.

Gli osservatori della sicurezza online hanno da tempo messo in guardia il pubblico sul ruolo dell’intelligenza artificiale generativa nell’aumento del materiale pedopornografico generato sinteticamente e delle immagini intime non consensuali (NCII) coperte dall’Elimination Act del 2025. Secondo una nuova legge statunitense, gli editori online devono soddisfare le richieste di rimozione dei deepfake senza consenso, pena sanzioni.

Rapporto per il 2024 Fondazione Internet Watch (IWF) hanno scoperto che gli strumenti di intelligenza artificiale generativa erano direttamente associati a un aumento del numero di materiale pedopornografico sul dark web, che raffigurava prevalentemente giovani ragazze in scene di sesso o alterava la pornografia digitale per includere immagini di bambini. Strumenti di intelligenza artificiale e app ‘nude’ legate alla crescita cyberbullismo E Violenza sessuale tramite intelligenza artificiale.