SAN JOSE, California – Nvidia ha affermato che le opportunità di guadagno per i suoi chip di intelligenza artificiale potrebbero raggiungere almeno 1 trilione di dollari (1,3 trilioni di dollari) fino al 2027, poiché la società delinea una strategia per competere in modo più aggressivo nel mercato in rapida crescita per l’esecuzione di sistemi di intelligenza artificiale in tempo reale.

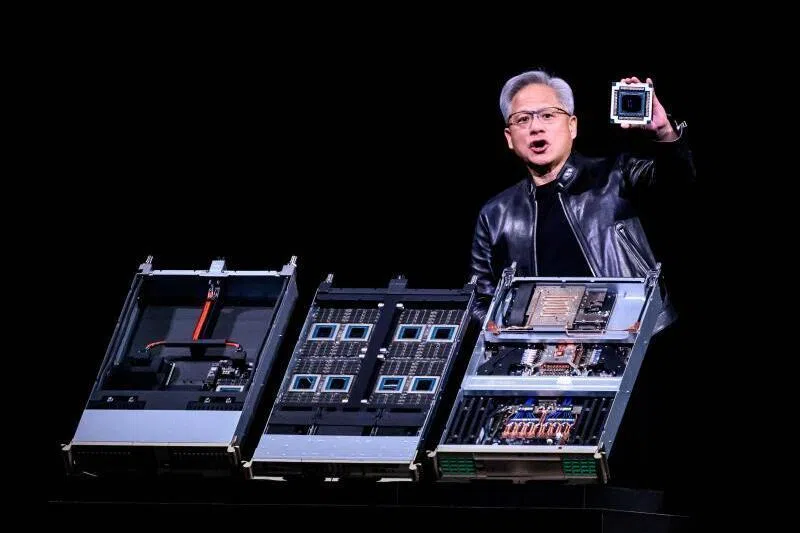

Il CEO Jensen Huang ha presentato un nuovo processore centrale e un sistema di intelligenza artificiale basati sulla tecnologia di Groq, una startup di chip la cui tecnologia Nvidia ha concesso in licenza per 17 miliardi di dollari, alla conferenza annuale degli sviluppatori GTC a San Jose, in California, a dicembre.

Le mosse fanno parte dello sforzo di Huang di consolidare la posizione dell’azienda nel cosiddetto inference computing, il processo di risposta a domande in cui i suoi processori grafici affrontano una maggiore concorrenza da parte di unità di elaborazione centrale e processori personalizzati costruiti da aziende del calibro di Google. I chip Nvidia hanno dominato il processo di addestramento dei modelli di intelligenza artificiale, che è stato al centro dell’attenzione negli ultimi anni.

“L’inferenza è arrivata”, ha detto il signor Huang. “E la domanda continua ad aumentare”, ha aggiunto.

Vestito con la sua caratteristica giacca di pelle nera, Huang ha parlato in un’arena di hockey con una capacità di oltre 18.000 persone durante la conferenza di quattro giorni che è diventata una delle più grandi vetrine della tecnologia AI. “Voglio ricordarvi che questa è una conferenza tecnica”, ha detto al pubblico.

Ma dopo un rally vertiginoso che ha reso Nvidia la prima azienda a raggiungere una valutazione di 5mila miliardi di dollari nell’ottobre 2025, sono sorti dubbi sulla sua crescita. Gli investitori si chiedono anche se il piano di reimmettere i profitti nell’ecosistema dell’intelligenza artificiale darà i suoi frutti. I commenti del signor Huang hanno fugato alcuni timori.

La previsione di 1.000 miliardi di dollari è superiore all’opportunità di entrate di 500 miliardi di dollari fino al 2026 che Nvidia ha citato per i suoi chip AI Blackwell e Rubin durante la sua ultima richiesta di utili a febbraio.

Le azioni di Nvidia sono aumentate brevemente in base alla nuova previsione, ma hanno ridotto i guadagni, attestandosi infine all’1,2%.

“Huang che identifica un’opportunità da 1 trilione di dollari fino al 2027 sottolinea la domanda sostenibile per l’infrastruttura AI di Nvidia nonostante le preoccupazioni degli investitori”, ha affermato l’analista di Emarketer Jacob Bourne.

“Segnala che Nvidia sta mantenendo la propria leadership nel mercato dei chip AI mentre l’intero settore dell’IA si espande verso l’implementazione su larga scala dopo la sperimentazione iniziale.”

Huang ha affermato che l’inferenza, in cui i sistemi di intelligenza artificiale rispondono a domande o eseguono compiti, sarà suddivisa in due fasi.

I chip Vera Rubin di Nvidia gestiranno un passaggio iniziale chiamato “prefill”, che converte la richiesta dell’utente da parole umane nel linguaggio dei “token” utilizzato dai computer AI.

I nuovi chip di Groq gestiranno una seconda fase di “decodifica” in cui il computer AI fornisce la risposta che l’utente sta cercando.

Dopo aver speso centinaia di miliardi di dollari negli ultimi anni in chip per addestrare i propri modelli di intelligenza artificiale, aziende come OpenAI, Anthropic e Meta stanno passando a servire centinaia di milioni di utenti utilizzando questi sistemi di intelligenza artificiale.

Ciò sta anche stimolando la domanda di CPU, che sono dominate da Intel e sono sempre più viste come una valida alternativa ai processori grafici Nvidia per l’implementazione di modelli di intelligenza artificiale.

“Vendiamo molte CPU standalone”, ha detto Huang presentando la nuova CPU Vera. “Si tratterà sicuramente di un business multimiliardario per noi”, ha aggiunto.

Il signor Huang ha anche mostrato la roadmap Feynman dell’azienda, ma ha offerto pochi dettagli oltre a un elenco dei vari chip che Nvidia prevede di includere nella piattaforma, inclusi processori AI e vari chip di rete. L’architettura Feynman è prevista per il 2028, dopo i chip Rubin Ultra dell’azienda.

L’azienda punta anche al mercato degli agenti IA autonomi con NemoClaw, che si integra con esso la piattaforma virale OpenClaw per aggiungere controlli di privacy e sicurezza allo strumento in grado di eseguire autonomamente un’ampia gamma di attività con una guida umana minima e ha generato un buzz globale.

“Ha migliorato l’intera conversazione. Ha migliorato l’intera idea di come gestiscono le infrastrutture”, ha affermato Bob O’Donnell, presidente di Technalysis Research, riferendosi agli annunci.

“Lui (Huang) veniva con un nuovo chip GPU e diceva, guarda, ecco il mio nuovo chip. Ora ha, sai, cinque rack di apparecchiature che compongono questi sistemi.” REUTERS

Link alla fonte: www.straitstimes.com